在 Vibe 了几个小工具之后,在本周我正式让 Codex 在安全的情况下介入了研究工作。

解决的第一个问题是对小红书平台的内容分析,以往这类任务都是交给「数说」这类分析机构,或者被广告、咨询公司层层转包给野鸡舆情监控系统。

现在我用了「最拟人」的方法来完成,核心思路是:

- 用代理接管 Chrome 浏览器,登录我的小红书账号,开始模拟浏览;

- 根据需求切「推荐」、「穿搭」、「旅行」、「美食」等频道,也可输入关键词进行搜索排序;

- 记录浏览器出现的真实内容,用小步滚动,小步截取的方式把合适的信息都保存在本地;

- 建立本地数据库,调用大模型分析截图,清洗数据;

- 绘制报告,先输出 HTML 格式,然后再截图发消息给我。

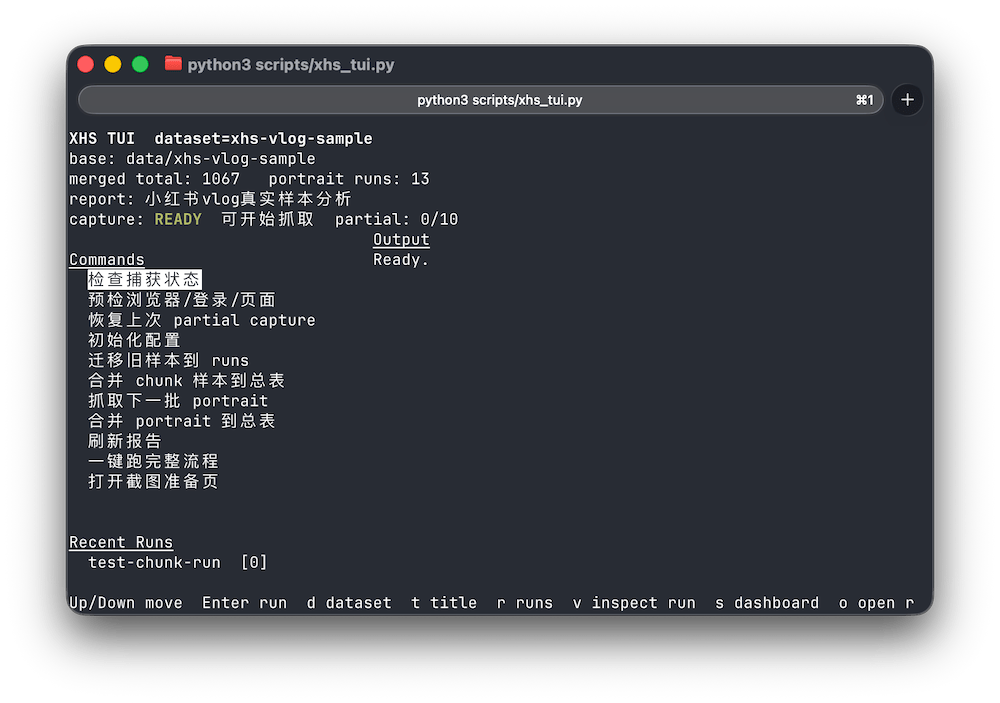

这样实现了基本的自动化,然后我改进这些脚本,套上 CLI 和 TUI 的皮,就能脱离 OpenClaw 来运作了。

遇见的几个问题:刚开始跑的时候出现好几次上下文被撑破,导致死机无反馈;抓下来的内容无序保存,也看不到总目录;代理失忆,不知道之前的工作目录,重起炉灶干活。

好在经过两天的调试就完全跑顺了。而到现在,我甚至可以脱离 OpenClaw ,只用 QQ 桥接消息的方式来控制这个信息程序。

脑海中的画面浮现出《社交网络》里好几个场景,再一次感叹「机械降神」的威力!